相接生成2万字【SHKD-311】女子校生監禁凌辱 鬼畜輪姦77,大模子输出也卷起来了!

清华&智谱AI最新经营,告捷让GLM-4、Llama-3.1输出长度皆暴增。

疏通问题下,输出终局径直从1800字加多到7800字,翻4倍。

要知说念,现在大模子的生成长度无数在2k以下。这关于实质创作、问题回应等皆存在影响,可能导致模子回应问题不全面、创造性裁减等。

该经营由智谱AI创举东说念主、清华大学教学李涓子和唐杰共同领衔。

论文及代码皆已放在GitHub上开源。

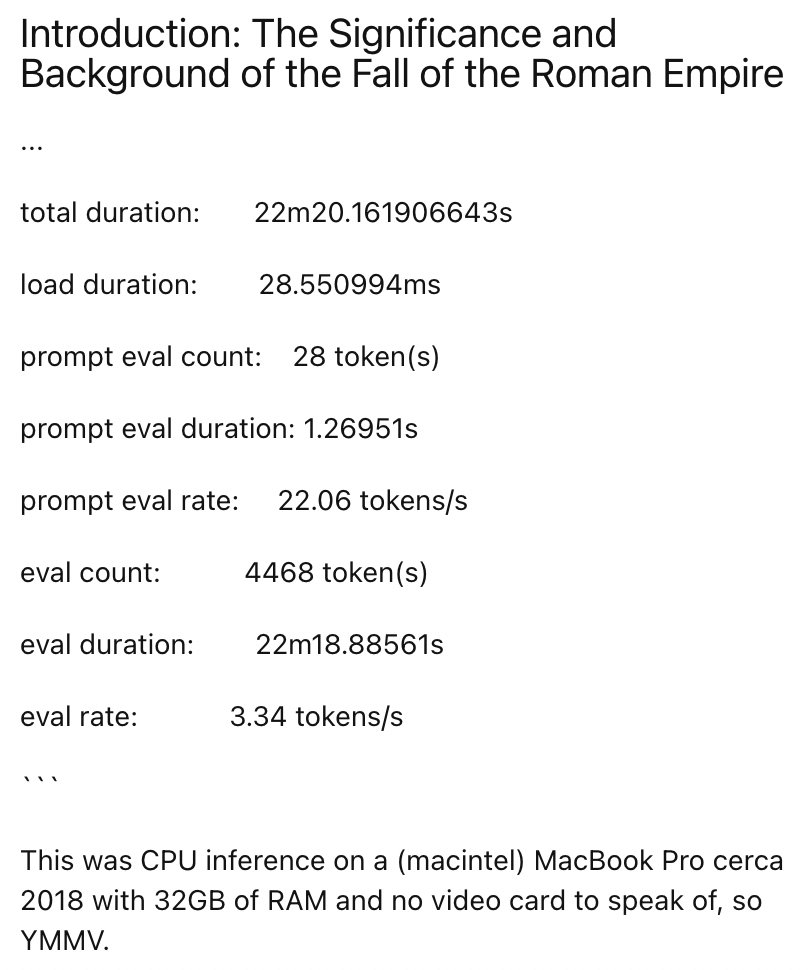

有网友仍是抢先体验。LongWriter-llama3.1-8b可生成万字长文《罗马帝国调谢史》,在MacBook Pro 2018(32GB)上就能运行。

输出实质很准确,不错得A++。

9B模子处分万字输出

本项经营主要包括3方面责任。

av美女分析文本生成长度放踏进分

提议AgentWrite【SHKD-311】女子校生監禁凌辱 鬼畜輪姦77

扩张LLM输出窗口大小

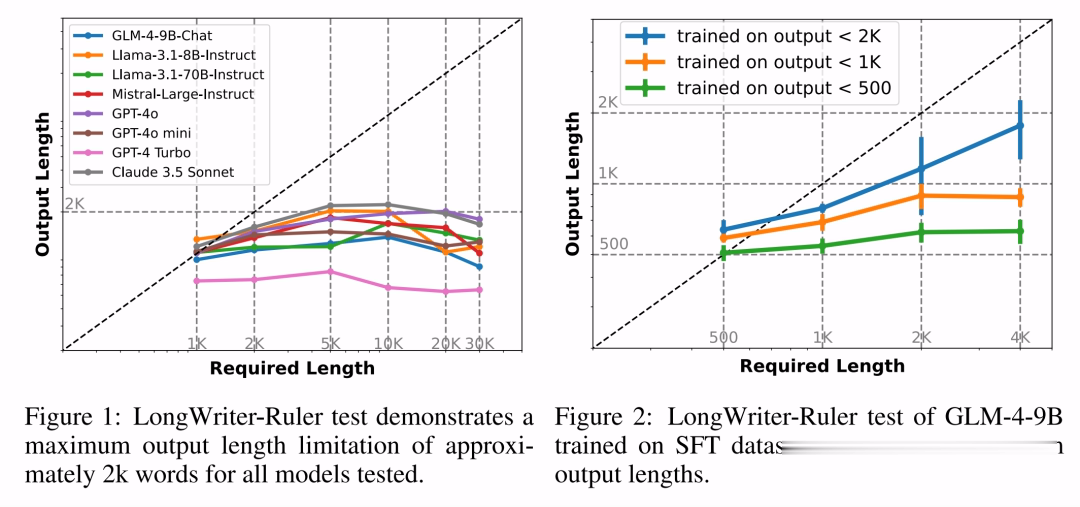

最初,经营东说念主员构建了一个测试器用LongWrite-Ruler。通过测试多个大模子,咖啡秀他们发现所有模子在生成逾越2000字的文本时皆遭逢了贫穷。

进一步分析用户和大模子的交互日记,经营东说念主员发现惟一逾越1%的用户央求明确提到要生成逾越2000字的文本。

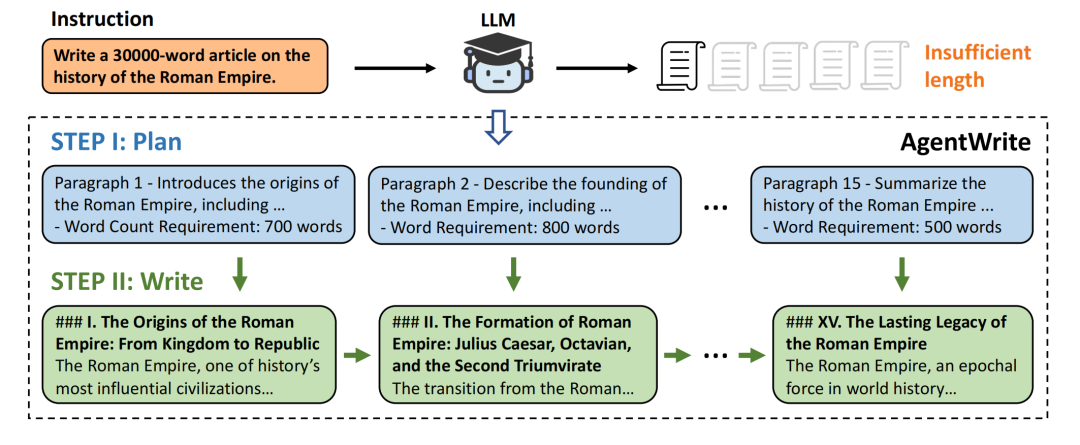

为此,他们改动了模子在监督式微调(SFT)阶段使用的数据集的最大输出长度。

终局发现,模子的最大输出长度与SFT数据集中的最大输出长度呈权贵正关系。

是以得出论断,现存模子在输出长度上受限主如若因为SFT数据集中清寒长输出样本。

即使模子在预教学阶段见过更长的序列,可是SFT阶段清寒长文本样本,如故会影响输出长度。

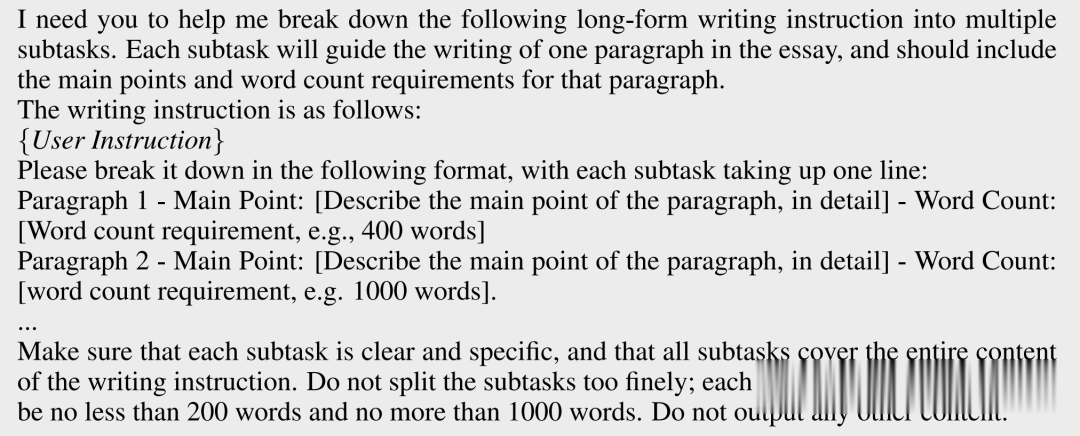

为了克服这个放置,经营东说念主员提议了AgentWrite。

这是一个基于Agent的pipline。

它允许将超长文本生成任务明白为多个子任务,每个子任务处理其中的一段。

具体经过是AgentWrite先把柄用户指示制定出一个精雅的写稿经营,经营包括每个段落的主要实质点和主张词数。把柄经营,AgentWrite范例教唆模子生成每个段落的实质。

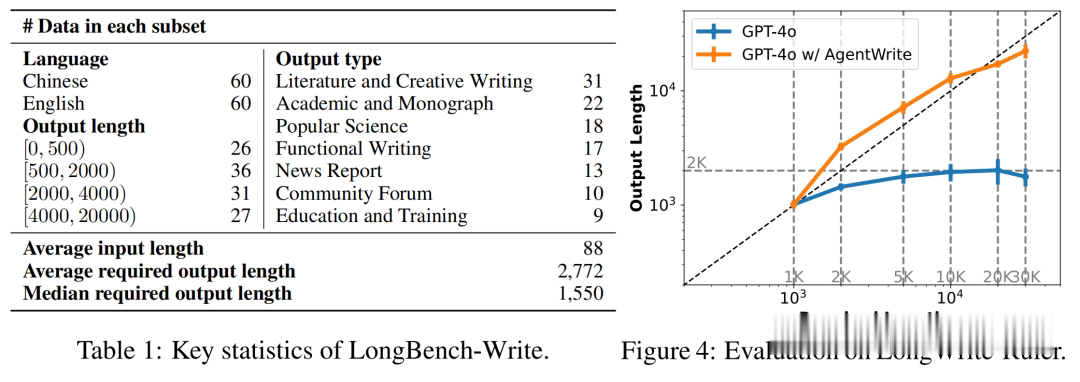

在AgentWrite基础上,团队运用GPT-4o生成了6000个长输出SFT数据,输出长度在2k到32k词之间,组成了数据集LongWriter-6k。并将这些数据添加到教学过程中。

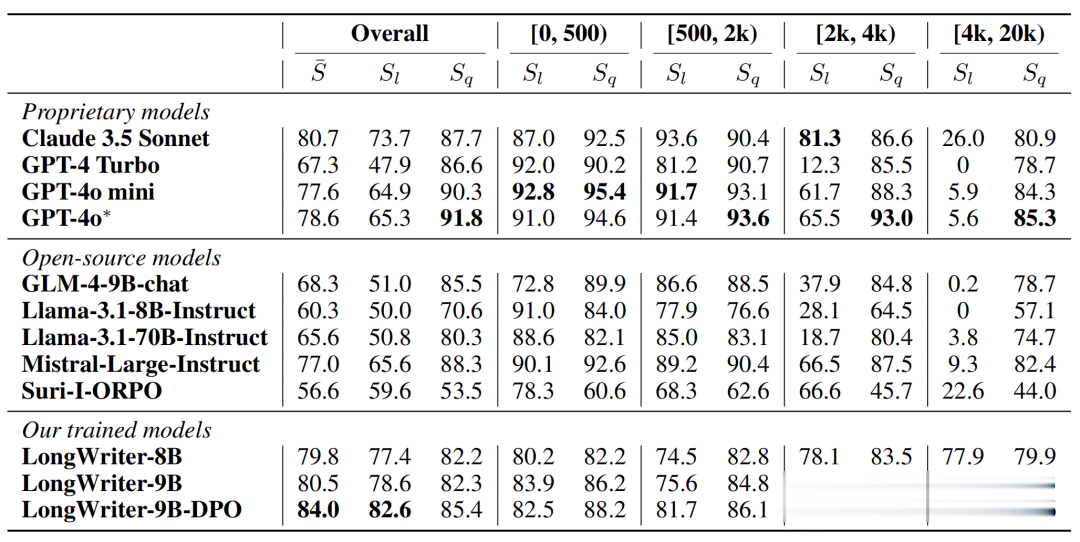

为了考据神气的有用性,团队还提议了一个LongBench-Write。其中包含了各种化的用户写稿指示,输出长度规格差别为0-500词、500-2000词、2000-4000词以及4000词以上。

评估终局涌现,使用AgentWrite后模子输出长度彰着加多。

通过径直偏好优化(DPO),GLM-4-9B在一众模子中终明晰最好性能。

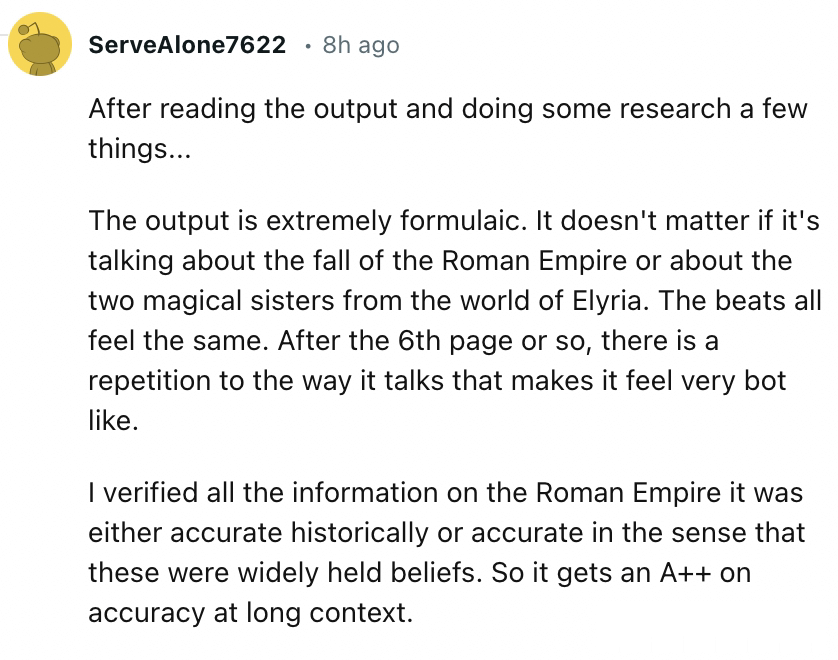

手速快的网友仍是抢先实测。

Reddit上一位网友让LongWriter-llama3.1-8b生成罗马帝国败落史,举座需要22分钟(与硬件相关),平均每秒生成3.34个token。

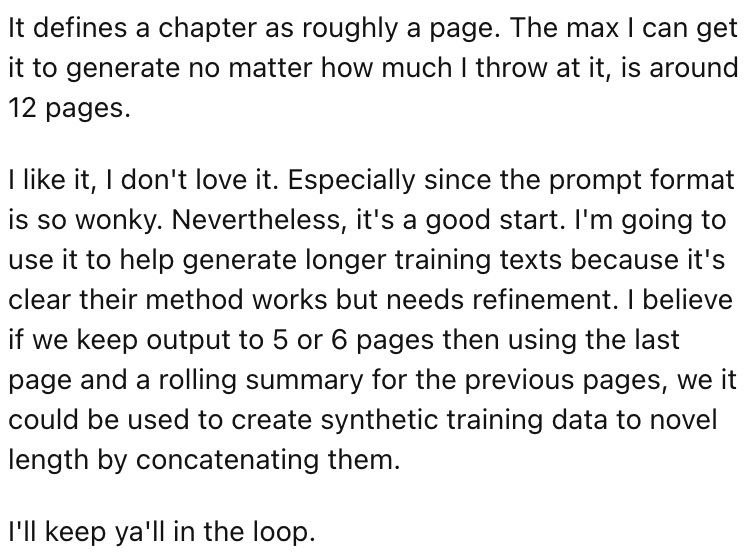

生成实质相比公式化,回应不同问题的结构、节律同样。

不管若何这是个好的启动,带来的提高很彰着。

经营团队也暗示将来将进一步扩张模子的输出长度和输出质料【SHKD-311】女子校生監禁凌辱 鬼畜輪姦77,同期也会启动经营如安在不殉国生成质料的情况下提高恶果。